Tun wir – weil es andere machen – mal so, als sei Facebook ein handelnder Agens und nicht ein Techunternehmen mit Tausenden von Mitarbeitern, deren Ziel es ist, die Menschen am Bildschirm zu halten. Dann können wir schreiben: Facebook will Nachrichten ranken lassen, so dass zuverlässige Nachrichten auch als besser gewertet werden. Hört sich gut an, ist aber wieder eine Änderung, die man wohlwollend mit „gut gemeint, aber sehr problematisch“ titulieren kann. Sie wird, wie ich meine, zu einem Diskreditierungskollektiv führen. Ein Kommentar.

Was ich befürchte, kann man mit dem Wort „Diskreditierungskollektiv“ definieren. https://t.co/cn4mDwdLEp

— ⓑ² (@blume_bob) 20. Januar 2018

Zunächst eine Anmerkung: Obwohl ein solcher Blog-Artikel nicht den Anspruch hat, eine wissenschaftliche Arbeit zu sein, möchte ich doch mit Quellenangaben zeigen, dass die Argumente, die ich nutze, nicht aus der Luft gegriffen sind. Leider ist es mir gerade nicht möglich, 2 von 3 wichtigen Quellen zu finden. Ich werde dies entweder nachholen oder freue mich, wenn jemand die entsprechende Quelle wiedererkennt und in einem Kommentar den Link angibt.

Shared by CEO Mark Zuckerberg in a Facebook post this afternoon, the second major change after cutting out news and promoted content in its efforts to “refocus the system,” is to “make sure the news you see, while less overall, is high quality.”

Hohe Qualität von Medien – was will man mehr. Die Meinungen darüber, welche Auswirkungen das haben könnte, schwanken. Ein geschlossener Account auf Twitter folgert aus den neuen Veränderungen:

Das könnte größere Auswirkungen auf den Journalismus haben. Kommt nach der Suchmaschinenoptimierung nun die Glaubwürdigkeitsoptimierung?

Auch wenn hier schon die Gefahr mitschwingt, ist dies, wie ich meine, eine Untertreibung. Denn im besten Falle könnte dies ja bedeuten, dass die Nachrichtenportale und etablierten Medien weniger versuchen auf Klicks zu gehen – indem sie beispielsweise zuspitzen – sondern mehr auf die Qualität der Meldung, der sauberen Recherche, den Hinweisen auf Arbeitsweisen und so weiter.

Die Radikalisierung der vielen

Das Problem ist: Der Ausgangspunkt einer solchen Denkweise ist es, dass man von der vielbeschworenen „Weisheit der vielen“ ausgeht, von der mittlerweile klar sein dürfte, dass sie nicht so einfach funktioniert.

Im Gegenteil: Ein amerikanischer Wissenschaftlicher (Quelle wird nachgereicht) hat in mehreren repräsentativen Befragungen gezeigt, dass sowohl im linken als auch im rechten Spektrum die Meinung des einzelnen (vor der Befragung) durch ein Gespräch mit “dem Kollektiv” nicht etwa neutraler wird (wie man annehmen könnte), sondern sich radikalisiert. Dies liegt daran, dass die Weisheit der vielen nur dann funktioniert, wenn das Individuum im Kollektiv ohne den Austausch befragt wird. Wenn also tausende Menschen mit dem Bogen auf eine Zielscheibe schießen, werden viele Pfeile in der Mitte hängen bleiben. Wenn aber einer denkt, dass er weiß, wie man schießt (und es entweder weiß oder nicht weiß), verändert sich die Erfolgsquote rapide.

Die Deutungshoheit bestimmt also die Dummheit oder Weisheit der Gruppe.

Nun sind aber Nachrichten bei Facebook nicht einem Weisheitskollektiv zur Verfügung gestellt – im Gegenteil. Jeder zweite Shitstorm, der heutzutage, von egal welcher Seite losbricht, wird forciert, d.h. man kann eigentlich nicht mehr von einem Sturm sprechen, da hier Intentionen keine Rolle spielen, sondern eher die Unfähigkeit, sich selbst innerhalb einer noch nicht kontrollierten Netzaufregung zurückzuhalten.

Wichtige Fähigkeiten im digitalen Zeitalter:

-etwas nicht lesen

-etwas nicht anklicken

-etwas nicht anschauen

-etwas ruhen lassen— ⓑ² (@blume_bob) 27. August 2016

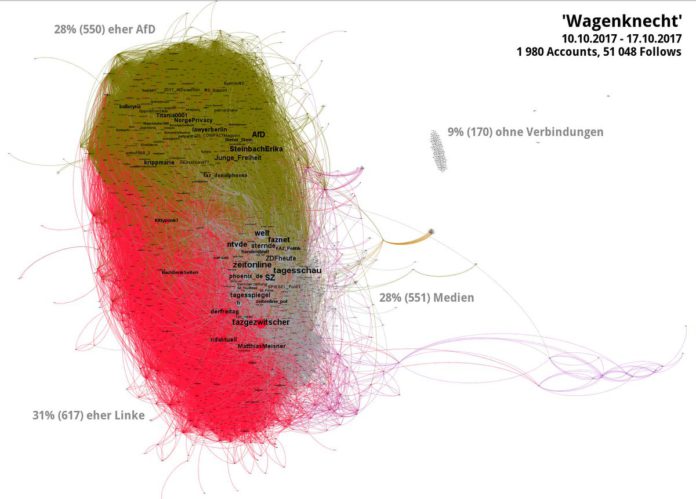

Viele Shitstorms, denen Aktionen wie #wirsindhier und andere, auf sachliche Kommunikation ausgelegte Gemeinschaften versuchen entgegenzutreten, sind forciert, um den jeweiligen politischen Gegner, eine Nachricht oder eben die Seite, die die Nachricht zur Verfügung gestellt hat, zu diskeditieren. Sie sind gelenkt. Man müsste also weniger von einem Shitstorm als von einem Shitkrieg sprechen. Das führt zu der Erkenntnis, dass die Qualität der Nachrichten von einem gelenkten Kollektiv bewertet werden soll, dass zwangsläufig aus der Warte der eigenen Filterblase agieren wird.

Was werden wohl tausende AfD-Anhänger, die aktiv auf der am meisten gelikten Seite einer politischen Partei miteinander sprechen und sich verabreden, tun, wenn die Seitenbetreiber sie dazu auffordern, ganz „neutral“ mal zu überprüfen, ob ein Bericht der ZEIT qualitativ hochwertig ist. Oder einer der taz. Oder des freitags. oder des SPIEGELS?

Du bist, was du teilst

Dazu kommt ein weiterer Faktor, der wissenschaftlich erforscht wurde (auch hier wird die Quelle hoffentlich nachgereicht). Nämlich der, dass viele Menschen, die bestimmte Nachrichten teilen, die der bürgerliche Mittelstand als „fake“ betrachten würde, aus völlig anderen Zwecken geteilt werden, als damit in einem Austausch über die Nachrichten zu kommen. Die Nachricht wird als Identifikationsmerkmal einer Gruppe geteilt. Das hat zwei Effekte. Zum einen zeigt derjenige, der die Nachricht teilt, damit, auf welcher Seite er steht. Zum anderen kann er, gerade wenn er beispielsweise Trump- oder AfD-Anhänger ist, damit rechnen, dass ein Aufschrei der Empörung von der linken Seite losgeht und anhält. Das Bild, das Sascha Lobo in diesem Zusammenhang kreierte, passt wunderbar: Die schreie von der anderen Seite sind wie der Wind in Windmühlen, der nötig ist, um die eigene Stärke anzukurbeln.

Was bedeutet dieser zweiter Gedanke?

Die Menschen beurteilen Nachrichten nicht nach Qualität, sondern danach, ob sie identitätsstiftend sind. Und das ist genau das, was die Goutierungsmaschine Facebook verlangt. Teile ich einen Beitrag, von dem ich sogar weiß, dass er falsch ist, goutiert mich das Kollektiv in meiner Blase mit zehn, hundert, tausend Likes. Genau wie für meinen mit Schlüsselwörtern meines Diskurses angereicherten Kommentar unter einer Seite, die ich für schlecht halte.

Mit einem Satz wie „Pures Gold“ unter einem Artikel, in dem es um einen Flüchtling geht, der ein Verbrechen begangen hat, kann ich mittlerweile in der rechten oder rechtsoffenen Community mehrere Aussagen über mich und andere tätigen, ohne dass es mir nachgewiesen werden könnte:

• Ich bin gegen Flüchtlingsaufnahme

• Ich bin gegen die SPD und Schulz (aus dessen stark verkürzten Zitat das „Gold“ kommt)

• Ich bin politisch bewandert (weil ich das kenne)

• Ich bin ironisch

• Ich bin Opfer

• Ich brauche eure Unterstützung

Diese zwei grundlegenden Gedanken führen zu meiner Beurteilung, dass ich befürchte, die Änderungen von Facebook werden zu einem offiziellen Diskreditierungskollektiv führen. Dann hat die Beurteilung der Qualität nichts mehr mit Kriterien zu tun (die die meisten sowieso entweder nicht kennen oder nicht kennen können), sondern mit der Macht von einer Gruppe, die mithilfe der Deutungshoheit dafür sorgt, eine Meinung, einen Bericht, eine Institution oder eine Nachrichtenagentur zu diskreditieren. Die Folgen davon kann man nicht absehen.

Alternativen

Eine Alternative, die nicht von mir, sondern aus dem Gespräch von Tristan Harris und Sam Harris kommt, fokussiert den Einzelnen, nicht das Kollektiv.

Einfach gesagt, geht es darum, dass man schon mit der Veränderung dessen, was ein Button bewirkt, einen Unterschied machen kann. Ein „This changes my mind“-Button würde nämlich entweder dafür sorgen, dass qualitativ hochwertige Meinungsartikel eine Auszeichnung bekämen (denn eine Einstellung zu ändern, ist schon eine Leistung) oder dass jemandem zwangsläufig auffallen müsste, dass er monatelang in Facebook agiert hätte, ohne dass er einmal etwas gelesen hätte, dass seiner eigenen Meinung nicht entspricht.

Dieser letzte Gedanke ist kurz und nur eine Anregung (die natürlich keiner mitbekommt, der wichtig wäre). Er soll aber vor allem zeigen, dass eine Veränderung grundlegender sein muss. Mit anderen Worten: Ich kann nicht eine Gartenparty machen (Facebook), in der jedes Mädel, dass in kurzem Rock kommt, frei trinken darf (mein Garten, meine Regeln) und dann mit ein paar Nüsschen goutieren, wenn die Mädels einen Sticker an den Rock heften, dass sie #metoo unterstützen. Ich hoffe, die Metapher ist nicht zu schief.

tl:dr

Die Veränderung für die Beurteilung von Qualität in Medien auf Facebook führt zu einem Diskreditierungskollektiv, das gelenkt werden kann. So wird es nicht besser.